Modelos de lenguaje recursivo (RLM) son una técnica de inferencia desarrollada por investigadores del MIT CSAIL que trata las indicaciones largas como un entorno externo al modelo. En lugar de forzar todo el mensaje en la ventana de contexto del modelo, el marco permite que el LLM study, descomponga y se llame recursivamente a sí mismo mediante programación sobre fragmentos del texto.

En lugar de ampliar las ventanas de contexto o resumir información antigua, el equipo del MIT replantea el razonamiento de contexto largo como un problema de sistemas. Al permitir que los modelos traten las indicaciones como algo que pueden inspeccionar con código, los modelos de lenguaje recursivo permiten a los LLM razonar sobre millones de tokens sin necesidad de volver a capacitarse. Esto ofrece a las empresas un camino práctico hacia tareas de largo plazo, como análisis de código base, revisión authorized y razonamiento de varios pasos que rutinariamente rompen los modelos actuales.

Debido a que el marco está diseñado como un contenedor para los modelos existentes, puede servir como un reemplazo directo para aplicaciones que realizan llamadas directas a LLM.

El problema del contexto LLM

Si bien los modelos de frontera se están volviendo cada vez más sofisticados en el razonamiento, su capacidad para procesar cantidades masivas de información no aumenta al mismo ritmo. Este cuello de botella está impulsado por dos limitaciones distintas: la estricta restricción física sobre la cantidad de texto que un modelo puede procesar a la vez (longitud del contexto) y la “podredumbre del contexto”.

El desafío, argumentan los investigadores, es si es posible escalar el tamaño del contexto efectivo de los LLM de propósito normal en órdenes de magnitud sin volver a capacitarlos. Esta capacidad se está volviendo cada vez más importante para las aplicaciones empresariales, donde los LLM se adoptan para tareas de largo plazo que requieren el procesamiento de millones de tokens, un desafío que, según Zhang, no se puede resolver simplemente expandiendo las ventanas de contexto.

“Existe un argumento de entropía que implica que se necesitan exponencialmente más muestras de datos a medida que se aumenta el tamaño efectivo de la ventana de contexto”, dijo a VentureBeat Alex Zhang, coautor del artículo.

Los enfoques actuales para ampliar el contexto a menudo se basan en la compactación, donde el modelo resume partes más antiguas de la conversación para liberar espacio. Sin embargo, este método falla en tareas que requieren acceso aleatorio a detalles específicos ubicados en partes anteriores del mensaje.

Cómo funcionan los RLM

El concepto detrás de los RLM se extrae de los algoritmos “fuera del núcleo” utilizados en la informática clásica. Estos algoritmos están diseñados para procesar conjuntos de datos demasiado grandes para caber en la memoria principal de una computadora manteniendo los datos en un disco duro y recuperando solo los fragmentos necesarios según sea necesario.

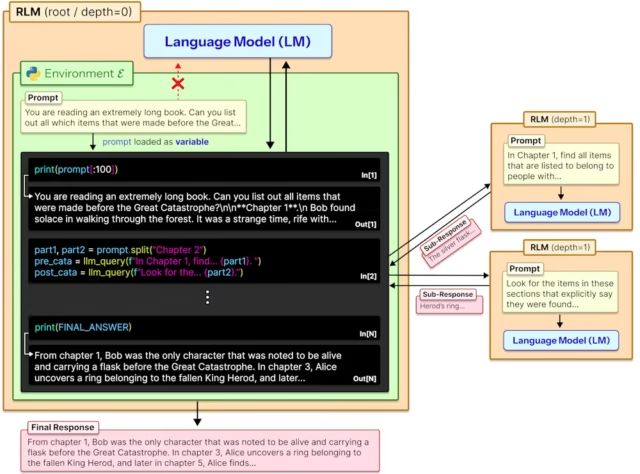

Los RLM aplican esta lógica a la IA generativa. En lugar de enviar un mensaje largo directamente a la crimson neuronal, el marco carga el texto como una variable de cadena dentro de un entorno de codificación Python. El LLM recibe un contexto normal sobre los datos (como el recuento complete de caracteres) pero inicialmente no “ve” el texto.

Una vez que el mensaje se almacena como una variable, el LLM actúa como programador. Escribe código Python para interactuar con la variable externa, utilizando comandos estándar para echar un vistazo a los datos. Por ejemplo, el modelo podría utilizar expresiones regulares para buscar palabras clave específicas como “Capítulo 1” o “resultados financieros”.

Cuando la ejecución del código encuentra un fragmento relevante, el RLM extrae solo ese fragmento específico en su ventana de contexto activa para su análisis.

Por ejemplo, si el mensaje es un libro enorme, el LLM podría escribir un bucle que identifique los límites de los capítulos y luego energetic una subllamada para resumir cada capítulo individualmente.

La arquitectura suele implicar dos agentes. Un “modelo de lenguaje raíz”, a menudo un modelo con muchas capacidades como GPT-5, actúa como orquestador. Planifica el enfoque, escribe el código y gestiona el flujo de datos dentro del entorno REPL. Un “modelo de lenguaje recursivo”, a menudo un modelo más rápido y más barato, actúa como trabajador. El LM raíz llama a este trabajador para procesar los fragmentos de texto específicos aislados por el código.

Debido a que el mensaje reside en la memoria del entorno en lugar de en la ventana de contexto del modelo, el sistema puede manejar entradas mucho mayores que el límite de entrenamiento del modelo. Es importante destacar que, para el usuario ultimate, el RLM se comporta exactamente como un modelo estándar: acepta una cadena y devuelve una respuesta. Esto permite a los equipos empresariales intercambiar llamadas API estándar por RLM.

Para los desarrolladores que quieran experimentar, el código RLM está actualmente disponible en GitHub.

“Un argumento clave para los RLM es que las tareas más complejas se pueden descomponer en subtareas ‘locales’ más pequeñas”, dijo Zhang. “Sin embargo, cómo realizar esta descomposición contexto/problema no es trivial, y el modelo debe ser capaz de realizarlo”.

RLM en acción

Para validar el marco, los investigadores probaron los RLM con modelos base y otros enfoques agentes como CodeAct y agentes de resumen en una variedad de tareas de contexto largo, incluida la recuperación y la respuesta a preguntas de múltiples saltos.

Los resultados demostraron fuertes ganancias de rendimiento en la escala de más de 10 millones de tokens. En NavegarComp-Plusun punto de referencia que involucra entradas de 6 a 11 millones de tokens, los modelos base estándar fallaron por completo, con una puntuación del 0%. Por el contrario, el RLM impulsado por GPT-5 logró una puntuación de 91,33%, superando significativamente al Agente de Resumen (70,47%) y CódigoAct (51%).

El marco también destacó en tareas con alta complejidad computacional. En OOLONG-Pairs, un punto de referencia de razonamiento denso en información donde la dificultad aumenta cuadráticamente con la longitud de entrada, los modelos básicos GPT-5 fallaron catastróficamente con una puntuación de solo 0,04%. El RLM logró una puntuación F1 (una medida equilibrada de precisión y recuperación) del 58 %, lo que demuestra capacidades emergentes para manejar tareas densas que paralizan los modelos estándar. De manera related, en tareas de comprensión de código (comparación CodeQA), el RLM duplicó con creces el rendimiento del modelo base GPT-5, pasando del 24% al 62%.

Con respecto al problema de la descomposición del contexto, los datos mostraron que, si bien el rendimiento base de GPT-5 se degrada rápidamente a medida que aumenta la complejidad de la tarea, el rendimiento de RLM se mantiene estable, superando consistentemente al modelo base en contextos de más de 16.000 tokens.

A pesar de la mayor complejidad del flujo de trabajo, los RLM a menudo mantenían costos promedio comparables o más bajos que los de referencia. En el punto de referencia BrowseComp-Plus, el RLM fue hasta tres veces más barato que la línea base de resumen.

Sin embargo, los investigadores observaron que si bien los costos medios son bajos, las trayectorias de RLM son “de cola larga”. Las ejecuciones de valores atípicos pueden resultar costosas si el modelo se atasca en bucles o realiza verificaciones redundantes. Si bien GPT-5 fue conservador en sus subllamadas, el código abierto Codificador Qwen3 El modelo a veces intentaba miles de subllamadas para tareas simples.

“Hoy en día, probablemente tendrás que implementar tus propias barreras y lógica para controlar el comportamiento del RLM”, afirmó Zhang. Sin embargo, plantea la hipótesis de que se podrían entrenar modelos futuros para gestionar sus propios presupuestos informáticos de forma más eficaz. Empresas como Prime Mind están planeando integrar RLM en el proceso de entrenamiento de modelos, posiblemente abordando los casos extremos donde el presupuesto de inferencia del modelo aumenta.

Para los arquitectos empresariales que deciden dónde hacer sus apuestas, el marco RLM ofrece una nueva herramienta para manejar problemas con gran densidad de información.

“Creo que los RLM siguen siendo extremadamente útiles para los chatbots (piense en largos historiales de chat), pero en última instancia abogan por una forma alternativa de utilizar los LM”, dijo Zhang. “Creo que los RLM funcionan en conjunto con métodos de recuperación estándar como RAG; no sirven como reemplazo y pueden usarse en diferentes entornos o juntos”.