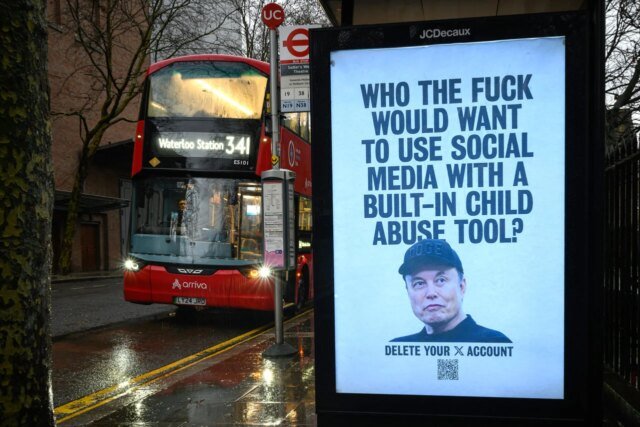

Semanas después de que la X de Elon Musk se viera inundada de imágenes generadas por inteligencia synthetic que mostraban a personas, incluidos niños, de manera sexualizada sin consentimiento, California está investigando cómo diablos sucedió. El fiscal basic del estado, Rob Bonta. anunciado El miércoles que abrirá una investigación sobre la situación para determinar si X y xAI, la compañía de inteligencia synthetic de Musk y el fabricante del chatbot Grok que se utilizó para generar las imágenes pornográficas, violaron la ley.

“La avalancha de informes que detallan el materials no consensuado y sexualmente explícito que xAI ha producido y publicado en línea en las últimas semanas es impactante. Este materials, que muestra a mujeres y niños desnudos y en situaciones sexualmente explícitas, ha sido utilizado para acosar a personas en Web”, dijo Bonta en un comunicado. También instó a xAI a tomar “medidas inmediatas” para garantizar que ese tipo de contenido no pueda crearse ni difundirse.

Bonta parece tener bastante apoyo público a la investigación. A encuesta reciente de YouGov encontró que un enorme 97% de los encuestados dijo que no se debería permitir que las herramientas de inteligencia synthetic generen contenido sexualmente explícito de niños, y el 96% dijo que esas herramientas no deberían ser capaces de “desnudar” a menores en imágenes.

La investigación se centrará en la tendencia que surgió en X durante las vacaciones de invierno, en la que los usuarios incitaron a Grok en la plataforma a modificar imágenes de personas para mostrarlas en varios estados de desnudez. La tendencia se hizo tan grande que, según la firma de análisis de contenido de IA CopyleaksGrok generaba una imagen sexualizada sin consentimiento cada minuto. Algunas de esas imágenes incluían niños, a los que los usuarios incitaron a Grok a desvestirse y representar en ropa inside o bikinis. A menudo, los usuarios solicitaban que Grok añadiera “glaseado de donut” a los rostros de los sujetos de las imágenes.

Musk, director ejecutivo de X, la empresa donde se compartían las imágenes, y de xAI, la empresa que fabrica el modelo de IA utilizado para generar las imágenes, ha optado por ofuscar o afirmar ignorancia de la situación. En una publicación realizada antes del anuncio de la investigación de California, Musk dicho“No tengo conocimiento de ninguna imagen de menores desnudos generada por Grok. Literalmente cero”.

La estrechez de su declaración hace mucho trabajo pesado, diciendo que no tiene conocimiento de ninguna “imágenes de menores de edad desnudos”. Esto no refuta la existencia de imágenes de desnudos, de menores de edad desnudos o de personas representadas en situaciones sexualizadas. Tampoco aborda el hecho de que muchas de esas imágenes no fueron consensuadas y se generaron sin el permiso de la persona representada. En innumerables casos, las imágenes se han utilizado directamente para acosar cuentas en X.

En la medida en que Musk estuvo dispuesto a admitir que tal problema es incluso posible, dijo que es culpa de los usuarios, no del modelo de IA o de la plataforma que difunde el contenido. “Obviamente, Grok no genera imágenes espontáneamente; lo hace sólo según las solicitudes de los usuarios. Cuando se le pide que genere imágenes, se niega a producir algo ilegal, ya que el principio operativo de Grok es obedecer las leyes de cualquier país o estado determinado”, dijo. “Puede haber ocasiones en las que el pirateo de los mensajes de Grok por parte de adversarios produzca algo inesperado. Si eso sucede, solucionamos el error de inmediato”.

Esto está más o menos en línea con la escasa respuesta que X ha ofrecido a la situación. En una publicación de X Security, la empresa dicho“Cualquiera que use o solicite a Grok que cree contenido ilegal sufrirá las mismas consecuencias que si cargara contenido ilegal”, pero no asumió ninguna responsabilidad por habilitarlo. Por si sirve de algo, a Musk también se le volvió a publicar burlonamente contenido creado como parte de la tendencia, incluidas imágenes generadas por IA de una tostadora y un cohete en bikini.

California es el primer estado del país en iniciar una investigación sobre la situación. Las autoridades de otros países, incluidas Francia, Irlandael Reino Unidoy Indiahan comenzado a investigar las imágenes sexuales no consentidas generadas por Grok y también pueden presentar cargos contra X y xAI. La Ley Take It Down, que se convirtió en ley el año pasado, no requiere que plataformas como X creen sistemas de notificación y eliminación de imágenes no consensuadas hasta el 19 de mayo de 2026.