En este punto, es seguro asumir que ha utilizado un chatbot como ChatGPT o Géminis. Además de hacer preguntas generales o obtener textos largos resumidoses posible que también hayas hecho una pregunta sobre salud. Tal vez estaba tratando de averiguar si valía la pena preocuparse por un síntoma o de entender los resultados de laboratorio, a menudo a altas horas de la noche, cuando no hay un médico disponible.

Informe de OpenAI de enero de 2026 descubrió que más del 5% de todos los mensajes ChatGPT a nivel mundial son sobre atención médica, y más de 40 millones de usuarios activos semanales en todo el mundo hacen preguntas sobre atención médica todos los días.

(Divulgación: Ziff Davis, la empresa matriz de CNET, presentó en 2025 una demanda contra OpenAI, alegando que infringió los derechos de autor de Ziff Davis al entrenar y operar sus sistemas de IA).

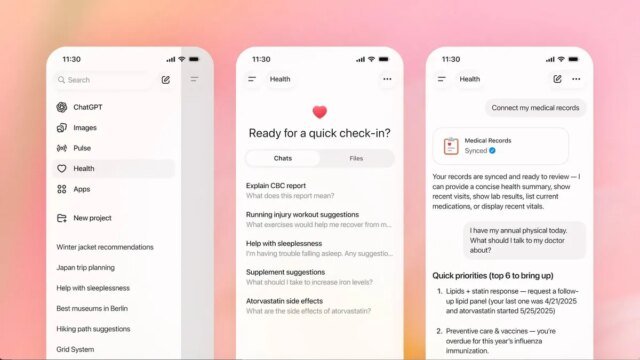

En enero de 2026, OpenAI introdujo ChatGPT Salud para convertir ese hábito en una característica dedicada. Esta “experiencia centrada en la salud” dentro de ChatGPT está diseñada para ayudarlo a comprender la información médica y prepararse para conversaciones reales con los médicos.

No es una herramienta de diagnóstico o tratamiento.

Entonces, ¿qué es exactamente ChatGPT Well being y en qué se diferencia de preguntarle a un chatbot ¿Una pregunta de salud aleatoria? Hagamos doble clic en la nueva pestaña Salud en ChatGPT.

¿Qué es ChatGPT Salud?

ChatGPT Salud no es una aplicación separada como esta Navegador de IAAtlas. Vive dentro de ChatGPT como un espacio o pestaña dedicada, que se centra en preguntas, documentos y flujos de trabajo relacionados con la salud.

La pestaña Salud en ChatGPT.

En su nota de lanzamiento, OpenAI cube que trabajó con más de 260 médicos que han ejercido en 60 países y docenas de especialidades durante dos años, revisando las respuestas de modelos relacionados con la salud más de 600.000 veces. Como resultado, no responde nada que suene médico de la misma manera abierta que un chat regular. En cambio, responde con más cautela, con límites más estrictos sobre cómo se explica la información e indicaciones más claras para buscar atención profesional.

ChatGPT Well being está disponible en la net y en la aplicación móvil. No necesita descargar nada ni registrarse fuera de ChatGPT. El acceso depende de la ubicación y la etapa de implementación, pero puedes unirte al lista de espera.

A partir de principios de 2026, estará disponible en EE. UU., Canadá, Australia, partes de Asia y América Latina, donde ChatGPT ya admite funciones de salud. Actualmente no está disponible en la UE y el Espacio Económico Europeo, el Reino Unido, China y Rusia. OpenAI ha dicho que la disponibilidad se ampliará, pero los plazos varían según la región debido a las regulaciones locales y las reglas de datos de salud.

Cómo funciona ChatGPT Salud

ChatGPT Well being usa el mismo subyacente modelos de lenguaje grandes (LLM) como ChatGPT. Haces una pregunta y el modelo genera una respuesta. La diferencia con la Salud es el contexto, la base y las limitaciones.

Alex Kotlarfundador de Bystro AIuna plataforma LLM centrada en genética para conocimientos de salud, le dijo a CNET que OpenAI no construyó un nuevo modelo de salud elementary.

“No han creado un modelo que de repente comprenda mucho mejor los registros médicos. Sigue siendo ChatGPT, simplemente conectado a sus registros médicos”, dijo Kotlar.

Well being extrae los datos que elige sincronizar, pero no puede acceder a ellos a menos que usted le otorgue permiso explícitamente. Además de los registros médicos, puede conectar aplicaciones como Salud de la manzanaresultados de laboratorio de Registros de funciones y alimentos de Mi FitnessPal. También puedes vincular Vigilantes del peso para GLP-1 concepts de comidas, Instacart para convertir planes de comidas en listas de compras y Pelotón para recomendaciones de entrenamiento. Esto permite que la IA proporcione información personalizada basada en su historial, en lugar de consejos genéricos.

Estas conversaciones ahora siguen reglas más estrictas en cuanto al tono, el abastecimiento y el estilo de respuesta, que OpenAI cube que prueba utilizando su marco de evaluación. banco de salud. Utiliza rúbricas escritas por médicos para calificar las respuestas del modelo en 5000 conversaciones de salud simuladas, aplicando más de 48 000 criterios específicos para evaluar la calidad y la seguridad.

Puede cargar documentos en Salud, usar comandos de voz y hacer todo lo que normalmente haría en un chat regular. Si está revisando varios resultados de pruebas o preparándose para una visita a un especialista, Salud puede realizar un seguimiento de lo que ya ha compartido y ayudarle a organizar la información a lo largo del tiempo.

OpenAI sugiere usarlo para revisar resultados de laboratorio, organizar preguntas antes de una cita, traducir el lenguaje médico a un inglés sencillo y resumir documentos extensos como notas de alta o explicaciones de seguros.

OpenAI es explícito en que la herramienta está destinada a respaldar las conversaciones con los profesionales de la salud, no a acortarlas. No puede ordenar pruebas, recetar medicamentos ni confirmar un diagnóstico. Si lo tratas como un médico, lo estás usando incorrectamente.

Pero Dr. Saurabh Gombarteacher clínico en Stanford Well being Care y director médico de Átropos Saluddijo a CNET, “Creo que la preparación y la educación en sí mismas ya cruzan la frontera y se convierten en consejos médicos”.

Salud mantiene las conversaciones, las aplicaciones conectadas, los archivos y la memoria específica de Salud separados de sus chats principales, para que los detalles de salud no vuelvan al resto de ChatGPT. Sin embargo, Well being puede utilizar la memoria de los chats habituales. Digamos que mencionaste una mudanza reciente o un cambio de estilo de vida, como volverte vegano. La salud puede aprovechar ese contexto para hacer que la conversación sea más relevante.

También puede rastrear patrones a lo largo del tiempo. si te conectas Salud de la manzanapuedes preguntar sobre dormir tendencias, patrones de actividad u otras métricas, luego use ese resumen para hablar con su médico.

ChatGPT Well being y ChatGPT para atención médica no son lo mismo

ChatGPT Well being es una función del consumidor para el bienestar private. Centro de ayuda de OpenAI cube que HIPAA no se aplica a productos de salud para el consumidor como Well being. HIPAA es la Ley de Responsabilidad y Portabilidad del Seguro Médicoque protege a nivel federal la información médica confidencial de un paciente para que no se divulgue sin su consentimiento.

Por separado, OpenAI ofrece “ChatGPT para atención médica“para organizaciones que necesitan controles diseñados para uso clínico regulado y soporte para el cumplimiento de HIPAA, incluidos acuerdos de socios comerciales (por ejemplo, contratos entre proveedores de atención médica y compañías de facturación).

Si utiliza ChatGPT Well being, no ingresa a un sistema hospitalario, aunque sus registros médicos se pueden conectar con la función. Estás utilizando un producto de consumo con protecciones adicionales que controla OpenAI. Así que no asuma que “función de salud” equivale automáticamente a HIPAA.

Controles de privacidad y datos

OpenAI cube que Well being agrega protecciones adicionales además de los controles existentes de ChatGPT, incluido “cifrado y aislamiento especialmente diseñados para mantener las conversaciones de salud protegidas y compartimentadas”.

Un portavoz de OpenAI le dijo a CNET que las conversaciones y los archivos en ChatGPT están cifrados en reposo y en tránsito de forma predeterminada, y que Salud agrega protecciones en capas adicionales debido a la naturaleza smart de los datos de salud. El portavoz agregó que el acceso de cualquier empleado a sus datos de salud se limitaría a operaciones de seguridad y protección, y que el acceso es más restringido y tiene un propósito más limitado que los flujos de datos de productos típicos.

“Cuando los consumidores escuchan que algo está cifrado, a menudo piensan que nadie puede verlo. En realidad, no es así como funciona. Cifrado en reposo no significa que la propia empresa no pueda acceder a los datos”, dijo Kotlar.

Puedes desconectar aplicaciones, eliminar el acceso a registros médicos y eliminar recuerdos de Salud. Dane Stuckey, director de seguridad de la información de OpenAI, también cube que las conversaciones de salud no se utilizan para entrenar sus modelos básicos de forma predeterminada.

Aún así, “más protegido que los chats normales” no es lo mismo que estar libre de riesgos. Ni siquiera una seguridad sólida puede eliminar todos los riesgo vinculado al almacenamiento de información médica confidencial en línea. Esa es una de las razones por las que la privacidad Los expertos han instado a los usuarios. pensar detenidamente antes de cargar registros médicos completos en cualquier herramienta de inteligencia synthetic.

Limitaciones y preocupaciones de seguridad

ChatGPT Well being puede ayudarlo a comprender la información, pero todavía puede hacer las cosas mal. Existe el riesgo de que la gente tome las respuestas de Salud al pie de la letra. En el mundo precise, todo el mundo quiere respuestas rápidas y la IA puede parecer convincente incluso cuando debería ser cautelosa. Como period de esperar, ECRI (una organización sin fines de lucro para la seguridad del paciente) incluyó a los chatbots de IA como el Estándar de tecnología sanitaria número uno para 2026.

Alucinacionesel hábito de la IA de producir detalles incorrectos con confianza, importa mucho más en el cuidado de la salud que cuando se le pide que lo haga resumir un PDF. si una herramienta fabrica completamente un estudiomalinterpreta un valor de laboratorio o exagera lo que significa un síntoma, podría estar poniendo en grave peligro su salud.

“El mayor peligro para los consumidores es que, a menos que tengan antecedentes médicos, les resultará difícil evaluar cuándo cube algo bien y cuándo cube algo mal”, dijo Kotlar.

Cuando se le pidió que comentara sobre las tasas de alucinaciones, el portavoz de OpenAI dijo que los modelos que impulsan ChatGPT Well being han “reducido drásticamente” las alucinaciones y otros errores de alto riesgo en conversaciones médicas desafiantes. Según las evaluaciones internas de HealthBench de OpenAI, GPT-5 scale back ocho veces las alucinaciones en situaciones de salud difíciles en comparación con modelos anteriores, scale back los errores en situaciones potencialmente urgentes en más de 50 veces en comparación con GPT-4o y no muestra fallas detectadas en el ajuste al contexto de salud world.

La compañía también cube que es mucho más possible que sus modelos más nuevos hagan preguntas de seguimiento cuando no están seguros, lo que, según afirma, scale back el riesgo de respuestas seguras pero incorrectas.

“Las empresas detrás de estas herramientas deben compartir que han implementado este tipo de controles y equilibrios o estos puntos de referencia para garantizar que la calidad de la respuesta sea alta”, cube Gombar a CNET.

OpenAI cube que la salud no está destinada al diagnóstico o tratamiento y debe apoyar, no reemplazar, la atención de los médicos.

Kotlar cube que la atención médica es compleja y está altamente regulada, por lo que herramientas como esta pueden ser “excelentes, pero también algo irresponsables al mismo tiempo”, ya que muchas cosas aún pueden salir mal.

¿Deberías usarlo?

La gente ya usaba ChatGPT para preguntas relacionadas con la salud incluso cuando no period el lugar adecuado para hacerlo. Debido a que Salud agrega barreras más estrictas para temas médicos, puede ser un poco más seguro que un chat estándar para ese propósito. Incluso Los médicos están usando IA. más en la práctica, y ese uso casi se ha duplicado entre 2023 y 2024, según la Asociación Médica Estadounidense, que encuestó a poco más de 1,100 médicos.

Gombar dijo que es possible que las interacciones entre la atención médica tradicional y la IA permanezcan, pero agrega que “hay margen de mejora y beneficio”. Mucha gente no tengo acceso confiable a la atención clínica de rutina, y si los LLM pueden al menos ayudar a determinar si alguien debe consultar a un médico, eso por sí solo podría ser significativo.

Si tienes cuidado con los datos que compartes, podría resultar útil. Puede utilizar Salud para traducir lenguaje médico o redactar preguntas para no quedarse congelado en una cita de 10 minutos. También puedes hacerle otras preguntas de bajo riesgo sobre dieta y ejercicio. Simplemente verifique siempre la información con fuentes confiables o un profesional. Nunca lo utilices para autodiagnosticarte, decidir si tomar o suspender una medicación o interpretar un síntoma grave.

“La atención sanitaria no es como codificar o escribir”, afirmó Kotlar. “Cuando falla, lo hace de maneras que son realmente peligrosas para un ser humano”.

ChatGPT Well being puede ayudarle a entender la información, pero no puede asumir responsabilidad por su salud. Como la mayoría de las herramientas de inteligencia synthetic, su valor depende de qué tan bien se comprendan sus límites.