Mucho antes de las redes sociales o los anuncios dirigidos, mi madre solía decir que la vida tiende a mostrarte lo que estás buscando. O aquello a lo que tienes miedo. O lo que sigues insistiendo en que no quieres.

Si estabas intentando quedar embarazada, de repente todos los que te rodeaban estaban embarazadas. Si querías terminar tu relación, las revistas en los estantes del supermercado estaban llenas de consejos sobre cómo “darle sabor a tu matrimonio”. Si eras soltero, notabas parejas por todas partes.

Los algoritmos de TikTok sabían que period bisexual antes que yo. No soy el único.

En ese momento, parecía una especie de psicología widespread, una observación sobre la atención, la proyección y las historias que nos contamos a nosotros mismos durante los momentos de transición. Nada místico. Simplemente la tendencia de la mente a organizar el mundo en torno a sus preocupaciones actuales.

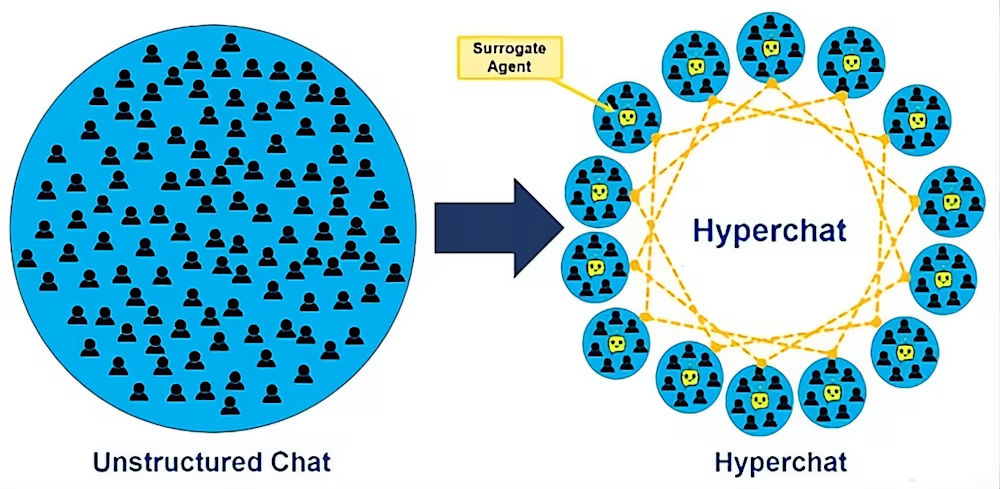

Pero hoy en día, ese sentimiento ya no está sólo en nuestras cabezas: es computacional, integrado en los sistemas que utilizamos todos los días. Plataformas como TikTok, Instagram y Google no solo reflejan lo que notamos; infieren activamente quiénes somos y qué viene después, basándose en datos demográficos como la edad y el género, así como en patrones de comportamiento. Y una vez que deciden en qué etapa de la vida te encuentras, te lo siguen mostrando, encaje o no.

En todas las plataformas sociales, los usuarios describen haber sido conducidos silenciosamente a través de un guión de vida estrecho y lineal, uno que a menudo se parece a algo como citas → compromiso → boda → embarazo → crianza de los hijos. Estos sistemas suponen que los usuarios están progresando a lo largo de una trayectoria esperada. Cuando las vidas se desvían de ese camino, por ejemplo, después de una ruptura, durante la infertilidad, después de un divorcio o por elección propia, el algoritmo a menudo no logra recalibrarse.

Lo que parece una coincidencia o molestia es algo más estructural: plataformas que construyen una versión de identidad que no se actualiza, incluso cuando la vida de una persona cambia.

Atrapado en una fase de la vida que nunca elegiste

En las plataformas sociales, los usuarios aún pueden encontrar contenido que no desean, a pesar de silenciar repetidamente las palabras clave o hacer clic en “no interesado”. La investigación muestra que los algoritmos de recomendación a menudo dependen mucho más de la participación implícita, como el tiempo de visualización y los clics, que de señales de retroalimentación explícitas, como ocultar o silenciar, lo que significa que el sistema puede continuar sirviendo a la vida que alguien alguna vez buscó (o se suponía que deseaba).

Elizabeth Loshteórico de los medios, estudioso de la retórica digital y profesor de estudios ingleses y estadounidenses en el School of William and Mary, dijo que esta persistencia tiene sus raíces en cómo se construyen los sistemas de recomendación.

“Sitios como TikTok e Instagram dependen de publicidad dirigida y modelos de recolección de datos que enfatizan la segmentación demográfica”, dijo Losh, quien también es autor de Democracia selfie: la nueva política digital de disrupción e insurrección. “[They] Corta y divide las audiencias por género, edad, lealtades políticas y otras categorías, fabricando necesidades y deseos para cada etapa de la vida”.

Esas etapas a menudo reflejan expectativas culturales más que una diversidad actual de usuarios. Los anunciantes tratan transiciones como el matrimonio, la fertilidad y la paternidad como momentos de consumo de alto valor, incentivando a las plataformas a clasificar a los usuarios en categorías de fases de la vida de las que es difícil salir una vez asignadas.

“Se puede ver cómo esas suposiciones quedan fijadas”, dijo Losh. “El poder persuasivo de los propios algoritmos de recomendación continúa reforzando las trayectorias de vida estandarizadas”.

Cómo determine el algoritmo quién eres

Las plataformas rara vez explican cómo infieren la “fase de vida” de un usuario, pero el desplazamiento en sí es un dato.

TikTok ha reconocido ese tiempo dedicado a mirar un video tiene más peso que la mayoría de las otras señales en su sistema de recomendación. Incluso una pausa por curiosidad, confusión o malestar puede interpretarse como interés. Una vez que un sistema asocia a un usuario con una categoría, contenido related puede crecer rápidamente.

Lauren Kleinprofesor de ciencias de datos y decisiones e inglés en la Universidad Emory y coautor de Feminismo de datoscube que estas inferencias reflejan normas históricas de género mucho más que “datos de usuario” neutrales.

“En muchos casos, la edad y el género son los únicos datos que las empresas conocen sobre sus usuarios”, dijo Klein. “A falta de [a] “Señal significativa, los diseñadores utilizan por defecto lo que suponen que alguien de una edad y género en specific querría ver”.

Esas suposiciones están determinadas por expectativas culturales arraigadas sobre la vida de los usuarios, incluidas las relacionadas con la belleza, la relación de pareja, la reproducción y el cuidado.

Informe de tendencias combinables

Debido a que los sistemas de recomendación y publicidad están impulsados por las ganancias, añadió Klein, hay pocos incentivos para cuestionar los valores predeterminados que parecen funcionar bien.

“Estas empresas están motivadas por sus propios resultados”, afirmó. “Si el contenido predeterminado sobre las fases de la vida parece generar interacción o compras, no hay obligación de considerar otros deseos o preferencias”.

Cuando el feed de TikTok contradice la realidad

emergente investigación sugiere que sistemas algorítmicos hacer más que unir a los usuarios con el contenido; también están dando forma a las identidades de las personas.

Investigadores describen este fenómeno como “persistencia algorítmica”, en la que los sistemas continúan ofreciendo contenido vinculado a una supuesta identidad mucho después de que ya no sea aplicable. Klein señala que debido a que los sistemas de recomendación están optimizados para la participación en lugar de la precisión, tienen pocos incentivos para recalibrarse a menos que el comportamiento del usuario cambie significativamente, algo que muchas personas no saben cómo hacer, o incluso no se dan cuenta de que es necesario.

“Hay un mecanismo de refuerzo social añadido”, afirmó Klein, añadiendo que los usuarios ya reciben mensajes constantes sobre lo que debería interesarles. “El algoritmo amplifica esa presión”.

Con el tiempo, esto crea una especie de disciplina ambiental, la tecnología empuja a los usuarios hacia una versión de la edad adulta que quizás no quieran, a la que no puedan acceder o que ya hayan superado.

“El aislamiento del desplazamiento private es una especie de ‘tecnología del yo'”, dijo Losh. “Alienta sutilmente a las personas a regularse según los guiones sociales dominantes”.

Rendimiento, juego y límites estructurales.

Si la persistencia algorítmica explica por qué los usuarios se “atascan” viendo contenido irrelevante, el rendimiento ayuda a explicar por qué retroceder no necesariamente los libera.

Las plataformas de vídeo de formato corto se basan en la visibilidad y el juego. Los usuarios hacen duetos, cosen, parodian y realizan versiones alternativas. Los creadores queer experimentan con el género; otros participan en lo que Losh llama “intercambio generacional”, representando versiones exageradas de padres o mayores. La cultura de la comedia y la remezcla ofrecen formas muy legibles de criticar los guiones de vida dominantes.

Esa visibilidad no carece de sentido. Losh señala que estas plataformas han creado espacio para experiencias que alguna vez se consideraron raras o invisibles: padres intersexuales que documentan sus vidas, personas que hablan abiertamente sobre embarazos ectópicos o asexualidad, trabajadoras sexuales que comparten las realidades poco glamorosas de su trabajo. Otras formas de narración relacional, como el contenido sobre matrimonios lavanda o el surgimiento de los “guncles”, desafían silenciosamente los guiones familiares heteronormativos a través del humor y el afecto en lugar de la discusión.

Pero la visibilidad, advierte Losh, no es lo mismo que el cambio estructural. Incluso cuando las plataformas se vuelven cada vez más expertas en identificar y amplificar contranarrativas, éstas continúan circulando dentro de algoritmos optimizados para clasificar a los usuarios en categorías comercializables. Eso significa que el contenido de bodas se convierte en contenido de bodas queer, o que el contenido acquainted se convierte en contenido acquainted no tradicional. La identidad puede cambiar, pero la lógica de las fases de la vida permanece intacta. En ese sentido, la personalización no elimina tanto el guión como lo adapta.

La lista de reproducción solicitada de Spotify te permite microgestionar tu propio algoritmo

Dentro de los sistemas de recomendación, la crítica no desencadena correcciones de manera confiable. Debido a que el compromiso en sí es la señal principal (tiempo de visualización, interacción, repetición), incluso el contenido destinado a desafiar una narrativa del ciclo de vida puede ser absorbido como evidencia de interés en ella. Una parodia de la cultura nupcial aún puede registrarse como compromiso con el contenido de la boda; una refutación de las normas parentales puede round junto con el mismo materials que critica.

¿Por qué es tan difícil restablecer su algoritmo?

La identidad algorítmica no es algo que los usuarios puedan actualizar con un solo clic. Los datos de entrenamiento reflejan el pasado. Los incentivos a las ganancias favorecen a categorías amplias. Y los sistemas de recomendación están diseñados para optimizar los ciclos de participación, no para reflejar las vidas complejas y no lineales de sus usuarios.

Diseñar para personas que no quieren tener hijos, que son coparentales, que son queer o poliamorosas, o que entran y salen de relaciones requiere tiempo, cuidado y voluntad de desafiar las suposiciones predeterminadas.

“Se necesita más trabajo para diseñar para los usuarios marginales”, dijo Klein. “Pero esos usuarios a menudo revelan dónde fallan los sistemas”.

Cuando se le preguntó cómo sería un sistema de recomendación más feminista o equitativo, Klein se mostró escéptico.

“No estoy segura de que exista un mecanismo publicitario feminista”, afirmó. “Pero un principio feminista que podemos tomar en serio es el rechazo”.

Para las plataformas, eso significaría permitir a los usuarios optar por no recibir anuncios dirigidos, permitirles retener su edad o género sin penalización, evitar incumplimientos de privacidad punitivos y brindarles a los usuarios formas de señalar cambios en sus vidas sin desencadenar automáticamente nuevas suposiciones.

Por ahora, la mayoría de las plataformas ofrecen una transparencia limitada y poco management significativo.

Viviendo con el retraso algorítmico

El algoritmo va por detrás de la vida actual. Se aferra a quién period alguien (o quién decidió que period) porque actualizar esa identidad es menos rentable que impulsarla hacia adelante.

Para los usuarios, ese retraso a menudo refleja el mismo guión de vida estrecho que la sociedad ha impuesto durante mucho tiempo. Lo nuevo no es la presión, sino la infraestructura que la ofrece.

El feed no refleja la realidad. Refuerza un guión acquainted, encaje o no.